Yönetici Özeti

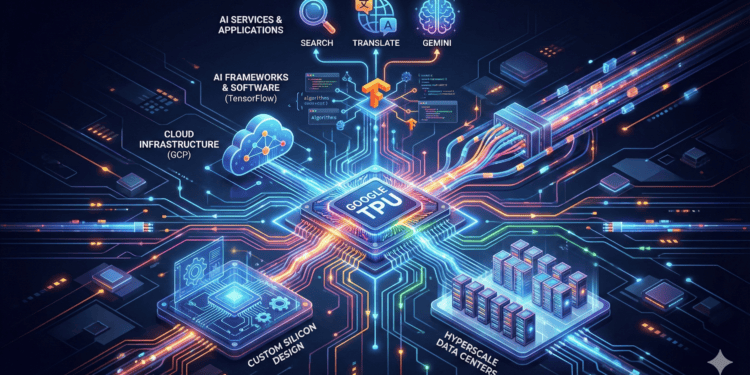

2025 ile birlikte yapay zekâ ekonomisi, GPU’ların kritik olduğu eğitim (training) fazından çıkarak “Çıkarım (inference) Çağı”na giriyor. Bu yeni dönemde değer zinciri, modellerin eğitilmesinden çok çıktıların müşteriye ulaştırılması ve monetize edilmesine dayanıyor. Alphabet, on yılı aşan TPU yatırımları sayesinde bu dönüşümün merkezinde yer alıyor. Şirket, değer zincirinin neredeyse tamamını kontrol ederek rakiplerinin ödemek zorunda olduğu “Nvidia vergisini” ortadan kaldırıyor ve sektörün belki de en düşük birim maliyetli çıkarım altyapısını kuruyor. TPU mimarisinin teknik verimliliği, GCP’nin fiyatlama gücü ve Alphabet’in ürün ekonomisinin sürdürülebilirliği Google’ı bu yeni evrenin kazananı yapabilir. Bu yazı, Alphabet’in TPU tabanlı hesaplama egemenliğinin teknik, finansal ve rekabetçi dinamiklerini detaylı incelemeyi hedefliyor.

Eğitimden Çıkarıma: Paradigma Değişimi

2022-2024 arası dönem, NVIDIA GPU’larının talebe yetişemediği ve büyük dil modellerinin eğitimi için gereken hesaplama kapasitesine ulaşmanın zorlaştığı bir “Eğitim Çağı” olarak yaşandı. Ancak yapay zeka ürünleri olgunlaştıkça, maliyet yapısı değişmeye başladı. Eğitim Çağı tek seferlik ve oldukça yüksek CAPEX ve amortisman maliyetleriyle karakterize edilirken, Çıkarım Çağı devamlı olan OPEX – özellikle enerji ve soğutma – ile token başına marjinal maliyet tarafından belirleniyor. Bu temel fark, yapay zeka ekonomisinin dinamiklerini yeniden şekillendiriyor.

Bu yüksek hacimli ortamda, GPU’nun genel amaçlı esnekliği bir maliyet yükü haline gelirken, TPU gibi ASIC’lerin (Uygulamaya Özel Entegre Devreler) alana özgü verimliliği ekonomik açıdan belirleyici hale geliyor.

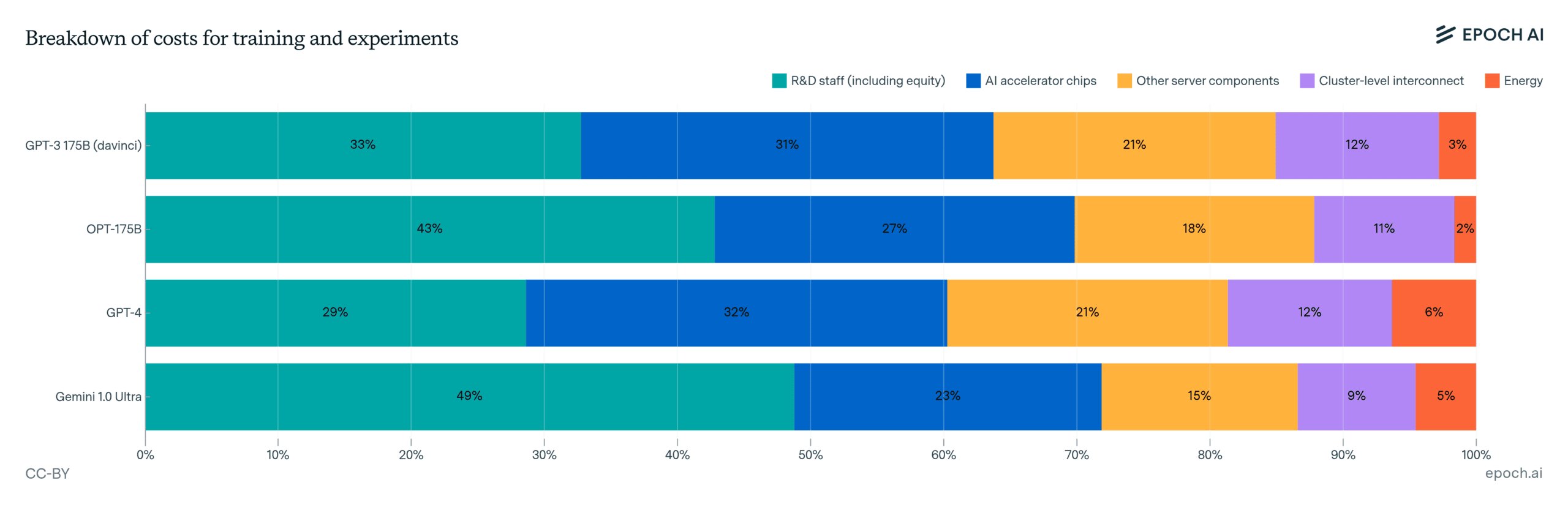

Model geliştirme maliyetinin önemli bir oranı çip maliyetinden oluştuğu için, Google’ın en büyük avantajı tam da burada ortaya çıkıyor. TPU’nun düşük birim maliyeti, bu denklemi Alphabet’in lehine önemli ölçüde değiştiriyor.

NVIDIA Vergisi ve Alphabet’in Maliyet Avantajı

Alphabet’in en büyük avantajı, rakiplerinin karşı karşıya olduğu “NVIDIA vergisi”ni ödemek zorunda olmaması. Microsoft ve Meta gibi şirketler NVIDIA’nın %70-80 brüt marjlı veri merkezi GPU’larını satın almak zorundayken, Google kendi çipini tasarlıyor, doğrudan TSMC gibi çip üreticileri ile çalışıyor ve yalnızca üretim maliyeti ile AR-GE maliyetine katlanıyor. Sonuç olarak Google, rakiplerinin ödediği maliyetin yalnızca yaklaşık %20’sine hesaplama gücü elde ediyor. Bu farkın geçici bir fiyat avantajı değil; iş modelinin yapısına işlemiş, zaman içinde bileşik etki oluşturan bir üstünlük olacağını düşünüyorum.

Aynı zamanda, Google’ın 2025 için öngördüğü 90 milyar doların üzerindeki CAPEX harcaması muhteşem yedili içerisinde en yükseklerden biri olmaya devam ediyor. Avantajı sayesinde yatırımlarını rakiplerine göre farklı noktalara odaklayabiliyor ve TPU’nun verimliliği sayesinde Google aynı tutarla rakiplerinden çok daha fazla efektif FLOPS kapasitesi yaratıyor.

Teknik Üstünlük: TPU Mimarisinin Anatomisi

Bu avantajın temelinde TPU’nun teknik tasarımı yatıyor. GPU’ların karmaşık bellek erişim desenlerine bağlı genel amaçlı mimarisinin aksine TPU, sistolik dizi adı verilen yüksek verimli bir matris hesaplama yaklaşımı kullanıyor. Bu yapı, verinin binlerce işlem arasında tekrar kullanılmasına olanak tanıyarak enerji tüketimini önemli ölçüde azaltıyor ve bu durum onu çıkarım süreci için çok ideal yapıyor.

Google’ın TPU geliştirme süreci 2013’e kadar dayanıyor ve ilk kullanım 2015’te başlıyor. Trillium (TPU v6e) ile birlikte Google, önceki nesle göre yaklaşık 5 kat performans yoğunluğu, iki kat bellek kapasitesi ve belirgin enerji verimliliği kazandı. Ancak gerçek sıçrama, tamamen çıkarım ölçeği için tasarlanan Ironwood (TPU v7) ile geliyor. Ironwood’un tek bir pod içinde 9.216 çipe ölçeklenebilmesi, NVIDIA’nın InfiniBand gibi daha pahalı çözümlerine ihtiyaç duymayan özel bağlantı teknolojisi ve YouTube ile Google Ads gibi Alphabet’in en büyük gelir kalemlerine yönelik SparseCore hızlandırıcıları, Google’ın bu dönemde neden ciddi bir rekabet avantajına sahip olduğunu net biçimde gösteriyor.

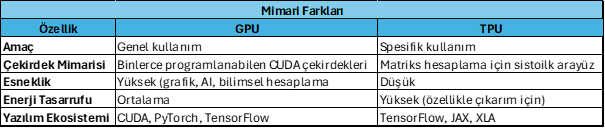

Mimari farklılıkları karşılaştırıldığında, TPU’nun spesifik kullanım amaçlı tasarımı çıkarım süreci için belirgin avantajlar sağlıyor. GPU’nun grafik, AI ve bilimsel hesaplama gibi alanlarda yüksek esnekliği varken, TPU AI odaklı düşük esneklikle karakterize ediliyor. Ancak enerji tasarrufu konusunda TPU, özellikle çıkarım için yüksek verimlilik sunarken GPU ortalama seviyede kalıyor. Yazılım ekosistemi açısından GPU CUDA, PyTorch ve TensorFlow ile çalışırken, TPU TensorFlow, JAX ve XLA’ya odaklanıyor.

TPU v7 Ironwood: Blackwell’e Karşı Rekabet

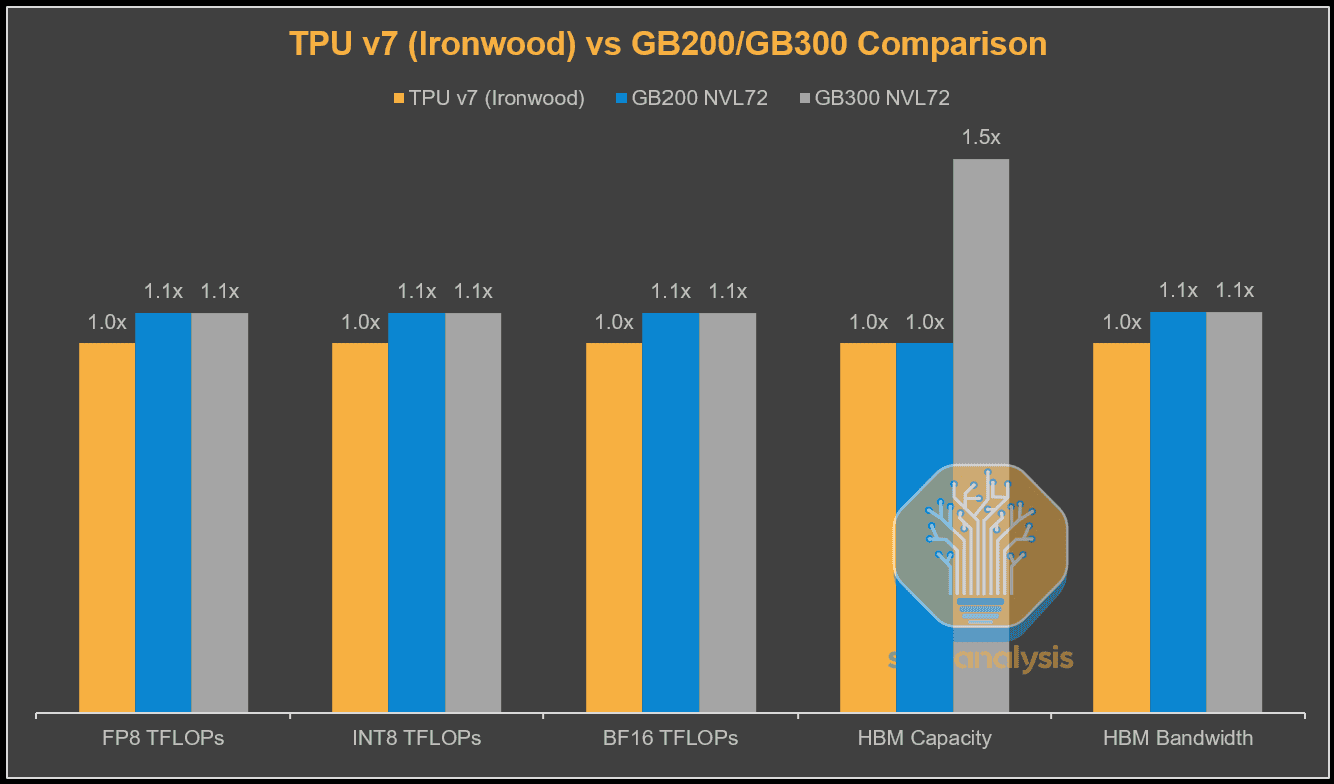

TPU v7 Ironwood, Google’ın NVIDIA’ya rakip olma stratejisinde önemli bir dönüm noktasını temsil ediyor. TPU v4 ve v5’te hesaplama performansı NVIDIA’nın amiral gemilerinden çok daha düşüktü. TPU v6 Trillium, H100/H200’e FLOPS açısından yaklaştı ancak iki yıl gecikmeli olarak piyasaya çıktı. TPU v7 Ironwood ile Google, Blackwell ile neredeyse aynı teorik FLOPS seviyesini sadece birkaç çeyrek gecikmeyle arayı önemli ölçüde kapattı.

Trillium sadece iki adet HBM3 yığınına sahipti, H100/H200 ise 5-6 yığına sahip. Bu da onu hesaplama gücünde Hopper’a yaklaştırsa da bellek kapasitesi ve genişbantta geride bıraktı. Ironwood ile GB200 ile karşılaştırıldığında FLOPS ve bellek genişbantı neredeyse aynı seviyede, 8-Hi HBM3E ile kapasite de eşit. GB300’e kıyasla (288GB, 12-Hi HBM3E) hala önemli bir açık var ancak bu fark çoğu kullanım senaryosunda kritik değil. TPU’nun Google’ın belki de en önemli ürünü arama motoru için olan avantajları buradaki dezavantajdan çok daha büyük.

Google için bir dönüm noktası olan TPU’ların dış müşterilere satışı tarafında Google marjını eklediğinde bile, TPU 7’yi harici müşterilere kiralama maliyeti GB200’den saatlik bazda yaklaşık %30, GB300’den ise %41 daha düşük. Bu fiyatlandırma aynı zamanda Anthropic’in GCP üzerinden aldığı hizmetin OpenAI’ya göre olan maliyet avantajını ve TPU’nun ekonomik avantajının harici müşteriler için bile geçerli olduğunu gösteriyor.

Diğer bir kritik nokta gösterilen tepe FLOPS değerlerine rağmen, TPU’lar Blackwell’den daha yüksek Model FLOP Utilization (MFU) oranına ulaşabiliyor.

Gerçek Dünya Kullanım Örnekleri

TPU’nun teorik avantajları, sektörün önde gelen oyuncularının stratejik seçimleriyle doğrulanıyor. Apple, “Apple Intelligence” modellerini TPU kümelerinde eğitiyor. Snap, TPU’ya geçerek yüzde 55 TCO tasarrufu elde etti. Midjourney, maliyetini aylık iki milyon dolardan 700 bin dolara düşürdü. Anthropic ise bir milyon adede kadar TPU kullanmayı taahhüt etti. Son günlerde Meta anlaşması ve Jensen Huang’ın OpenAI’ın TPU alımı konusunda Sam Altman ile konuştuğu haberleri gelmeye devam ediyor.

Bu örnekler TPU’nun yalnızca Google içi işler için değil, harici müşterilerin yapay zeka projeleri için de ideal olduğunu kanıtlıyor. Özellikle Anthropic gibi en başarılı ve en büyük modellerden birine sahip şirketlerin TPU’yu tercih etmesi, platformun yalnızca maliyet avantajı değil, aynı zamanda performans ve ölçeklenebilirlik açısından da rekabetçi olduğunu ortaya koyuyor.

Stratejik Etkisi

Google Cloud Platform (GCP), TPU avantajının en belirgin yansımalarından birini sunuyor. Bulu tarafındaki hızın ana itici gücü AI altyapısı ve TPU tabanlı hizmetler. TPU’nun düşük birim maliyeti sayesinde Google, Gemini gibi modelleri rekabetçi fiyatla sunabiliyor ve yüksek marjını koruyabiliyor.

Alphabet’in iç ekonomisinde ise TPU, özellikle Arama ve YouTube için hayati bir rol oynuyor. Arama sonuçlarında üretken yapay zekâ kullanımı, GPU tabanlı bir sistemde maliyetleri sürdürülebilirliği çok zor olacak şekilde token üretimi gerektiriyor. TPU’nun maliyet avantajı, bu geçişin kârlılığı koruyarak yapılmasını mümkün kılıyor. YouTube’un ağır iş yükleri için tasarlanan SparseCore hızlandırıcıları da yine TPU mimarisinin optimize edildiğini gösteriyor.

Riskler ve Zorluklar

En başta Google’ın TPU satışlarıyla doğrudan rakip olmaya başladığı NVIDIA’nın çok inovatif bir şirket olması ve TPU avantajını etkisizleştirmek için aktif olarak çalışması var. Potansiyel olarak daha iyi performans gösterecek modeller çıkarabilir ve Google’ın Nvidia’nın müşterilerini alma çabasını boşa çıkarabilir. Verimlilik, maliyet ve amaca özel hizmet gibi konularda TPU’lar daha iyi olsa da müşteriler daha iyi performans için Nvidia’nın Blackwell çiplerini yüksek maliyetlere rağmen tercih etmeye devam edebililr. Ayrıca yakında çıkacak Vera Rubin (R100) mimarisinde NVLink Fusion da ASIC’lerle arasındaki verimliği kapatmak üzere tasarlanıyor.

NVIDIA’nın en güçlü kaslarından biri CUDA ekosistemi. CUDA geliştirici topluluğunda çok önemli bir faktör ve geniş açık kaynak kütüphane yelpazesi sayesinde çok fazla ve farklı sayıda geliştiricinin verimli çalışmasını, çiplerden alınan maksimum verimi sağlıyor. Bu ekosistem avantajı, donanım tarafında ciddi mesafe kat eden Google’ın çok fazla mesafe kat etmesi gereken bir alan. Zira TPU ile çalışan kütüphaneler hala açık kaynak değil. Dolayısıyla GCP’yi erişilebilir kılması ve geliştiricileri bu tarafa çekmesi gerekir.

Diğer bir husus AWS, Microsoft ve Meta gibi rakipler kendi çiplerini geliştirerek dışa bağımlılıklarını azaltıyor. AWS’in Trainium ve Inferentia, Microsoft’un Maia ve Meta’nın MTIA çipleri, uzun vadede pazarı daha rekabetçi hale getirebilir. Bu rakiplerin kendi ASIC’lerini geliştirmesi, TPU’nun rekabetçiliğini azaltabilir.

Yatırım Tezi ve Değerleme

Alphabet’i tanımlarken eskiden kullanılan tanımların artık değişmesi gerekiyor. Büyük ölçekli arama motoru şirketi, platform sahibi, bulut yöneticisi gibi tanımların artık donanımdan yazılıma ve platformlara kadar çok kapsayıcı bir başlığa kavuşması gerekiyor.

10 yılı aşkın süredir devam eden TPU araştırmaları ve Google platformlarının da uzun yıllardır kullanılıyor olması hem maliyet avantajı hem sinerji açısından oldukça pozitif. Yalnızca iç kaynak kullanımında bile ölçek ekonomisi yakalanabilecekken dışarıya da satılmaya başlanması maliyet avantajını artırabilir.

Senaryo analizi yaparsak, boğa senaryosunda Çıkarım Çağı hızla büyüyor, TPU avantajı genişliyor, GCP pazar payı artıyor ve Alphabet AI ekosisteminin en avantajlı ve en komple oyuncusu haline geliyor. Temel senaryoda TPU avantajı korunuyor, GCP sabit büyüme gösteriyor ve iç ürünlerde karlılık iyileşiyor. Ayı senaryosunda bile NVIDIA TPU’dan daha iyi performans gösteren daha düşük maliyetli çipler piyasa sunarsa, rakipler de kendi çiplerini kullanmaya başlasa ve CUDA ekosistemi üstünlüğü devam etse, mevcut TPU konuşlandırması Google’ın iç kaynakları açısından önemli bir değer yaratmaya devam ediyor.

Sonuç: Çıkarım İmparatorluğu

Alphabet, yapay zeka çağının bu değişim evresinde 10 yıldan fazladır sürdürdüğü çalışmaların sonucu olan düşük maliyetli çıkarım süreci üzerinde dikey entegrasyonla beraber bir egemenlik kurdu. Aynı anda hem en büyük rakiplerine karşı ciddi bir maliyet avantajı kazanıyor hem de sağlayıcı Nvidia’ya rakip oluyor gibi duruyor.

Apple, Anthropic, Midjourney gibi şirketlerin stratejik seçimleri TPU’nun performansını somut biçimde doğruluyor. Yıllık on milyarlarca dolar tasarruf, GCP’nin hızlı büyümesi ve iç ürünlerde artan karlılık, finansal etkinin boyutunu gösteriyor. NVIDIA ve diğer rakipler ciddi tehditler oluştursa da, TPU’nun ölçeği, becerileri ve maliyet avantajı Alphabet’i benzersiz bir konuma götürebilir.

NVIDIA eğitim alanında liderliğini sürdürebilir; ancak günlük yaşamda milyarlarca kullanıcıya hizmet verecek yapay zeka uygulamalarının temelini oluşturacak olan uygulamalar, Alphabet’in TPU mimarisi etrafında şekillenebilir. Bu nedenle şirket, yalnızca bir teknoloji üreticisi değil, AI ekonomisinin altyapısını kontrol eden bir “çıkarım imparatoru” konumuna doğru ilerliyor. Şirketi yeniden değerlendirmek ve uzun vadeli potansiyelini tam olarak anlamak için önemli bir değişim.

Dolayısıyla yatırım tezi olarak portföylerde Nvidia ve AMD’nin ağırlığının azaltılıp Alphabet’in ağırlığının artırılabilieceğini düşünüyorum.

Not: Görsel Gemini BananaPro ile üretildi.

Ahmet Vefa Karabulut

Kaynaklar

https://www.ft.com/content/b8bd9240-50b1-488b-bdcf-5546f6609da3

https://epoch.ai/blog/how-much-does-it-cost-to-train-frontier-ai-models

https://newsletter.semianalysis.com/p/tpuv7-google-takes-a-swing-at-the

https://www.nasdaq.com/articles/cost-ai-compute-googles-tpu-advantage-vs-openais-nvidia-tax